引言

1 实验部分

1.1 研究对象

1.2 扫描方法

1.3 模型构建与评估

1.3.1 数据集

1.3.2 影像处理

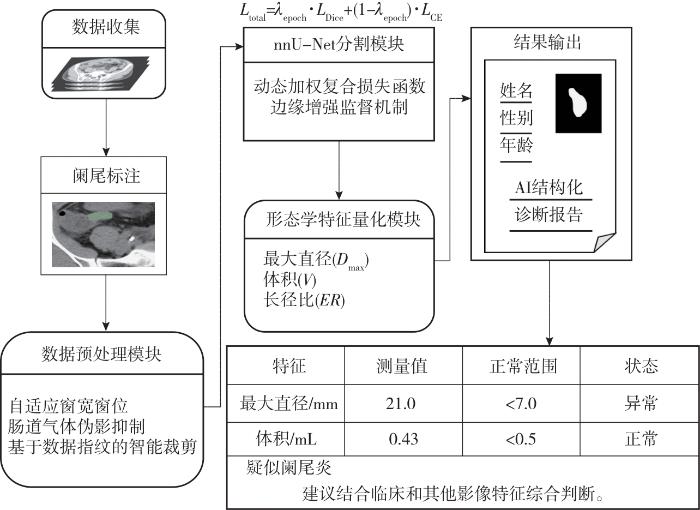

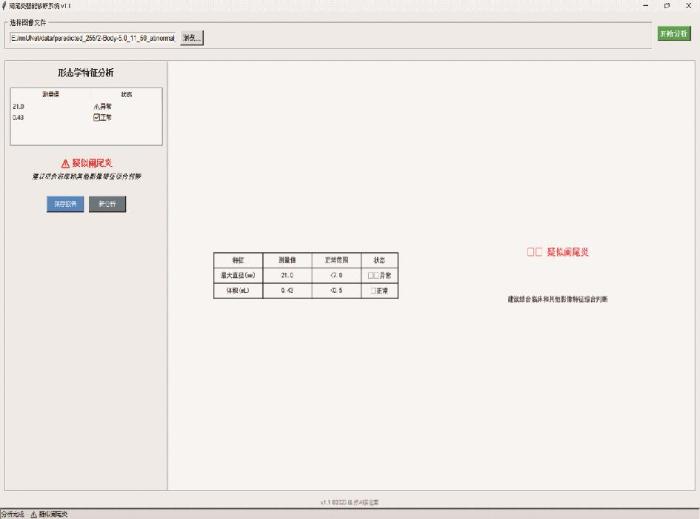

1.3.3 系统框架

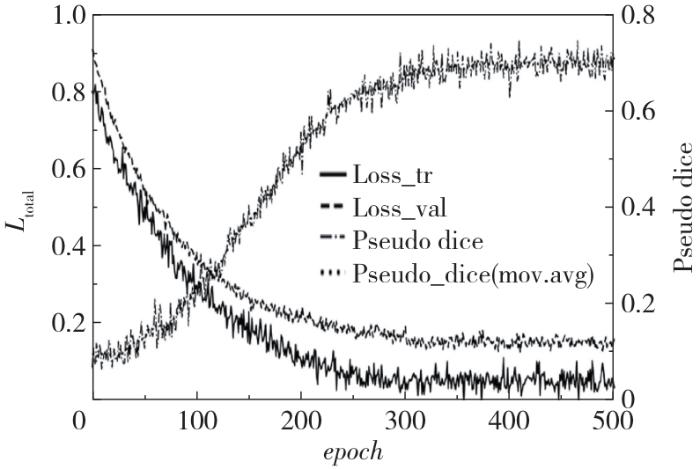

1.3.4 训练与评估

1.3.5 统计分析

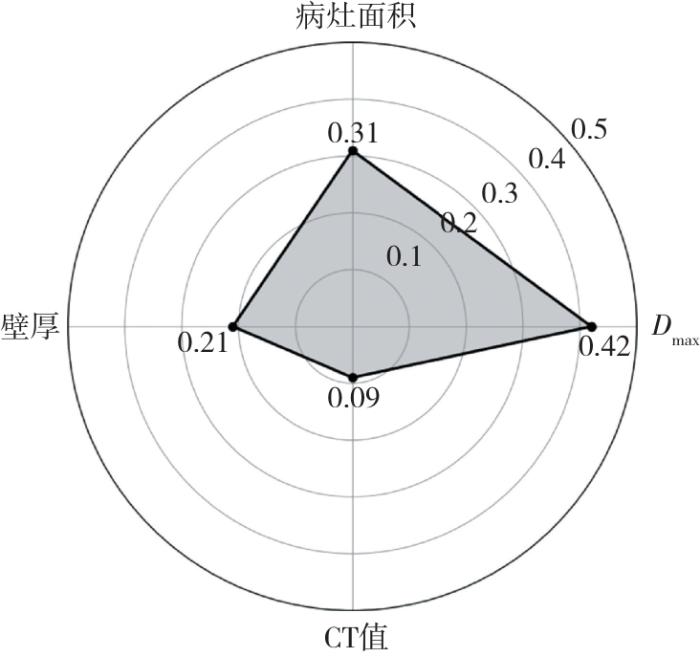

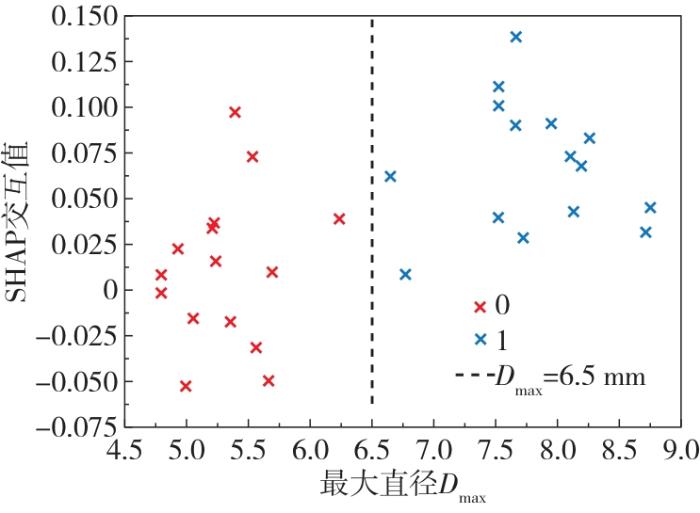

2 结果与讨论

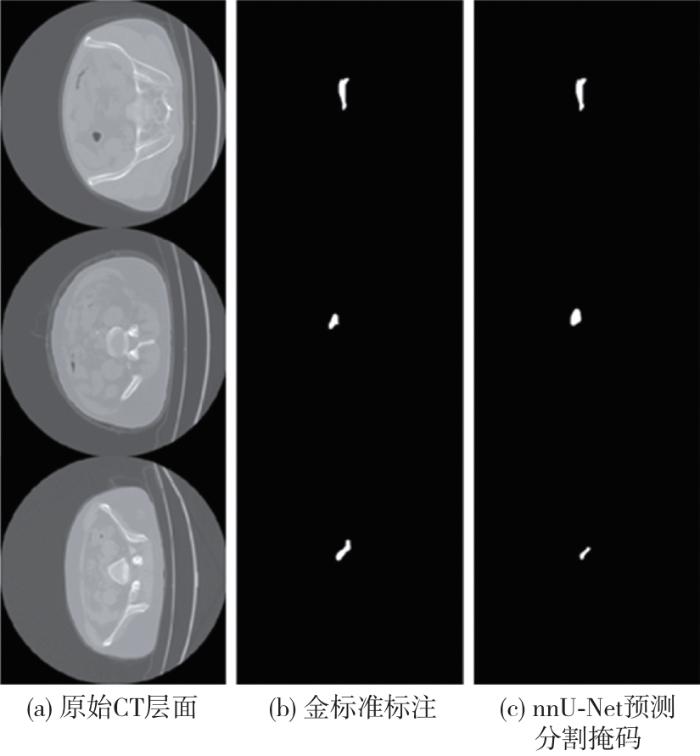

2.1 分割性能与结果可视化

表1 改进模型与多种分割模型在阑尾CT影像分割任务中的性能对比(n=54)Table 1 Comparison of appendix segmentation performance between proposed model and other classic models (n = 54) |

| 模型名称 | Dice系数/% | 与改进模型的p值(Dice) | IoU/% | 与改进模型的p值(IoU) | 平均推理时间/s |

|---|---|---|---|---|---|

| nnU⁃Net | 68.69 ± 5.1 | < 0.001* | 54.76 ± 4.7 | 0.002* | 25.7 |

| TransU⁃Net | 66.21 ± 4.9 | < 0.001* | 52.71 ± 4.4 | < 0.001* | 28.1 |

| Swin⁃U⁃Net | 64.52 ± 5.5 | < 0.001* | 51.12 ± 4.9 | < 0.001* | 31.3 |

| 改进nnU⁃Net | 72.35 ± 4.3 | — | 56.70 ± 3.8 | — | 23.5 |

所有指标均以均值 ± 标准差表示;p值为配对t检验结果,显著性水平设定为 p < 0.05,*表示统计学显著(p < 0.05)。 |

表2 消融实验中不同模块组合的分割性能对比(n = 54)Table 2 Performance comparison of different module combinations in ablation study on appendix segmentation (n = 54) |

| 模型名称 | Dice系数/% | 与最终模型的p值(Dice) | IoU/% | 与最终模型的p值(IoU) |

|---|---|---|---|---|

| Dice + CE | 68.12 ± 5.9 | < 0.001* | 54.10 ± 4.7 | 0.004* |

| Dice + CE +λ | 70.83 ± 4.7 | 0.008* | 55.96 ± 4.1 | 0.021* |

| Dice + CE + λ + 边缘增强 | 72.35 ± 4.3 | — | 56.70 ± 3.8 | — |

所有指标均以均值 ± 标准差表示;p值为配对t检验结果,显著性水平设定为 p < 0.05,*表示统计学显著(p < 0.05)。 |

表3 模型在阑尾与肝癌CT数据集上的分割性能对比Table 3 Comparison of segmentation performance on appendix and liver CT datasets for generalization evaluation |

| 数据集 | 测试目标 | Dice系数/% | p 值(Dice) | IoU/% | p值 (IoU) |

|---|---|---|---|---|---|

| 中日友好医院阑尾数据集(n=54) | 阑尾组织 | 72.35 ± 4.30 | < 0.001* | 56.70 ± 3.80 | < 0.001* |

| 肝癌CT数据集(n=130) | 肝癌区域 | 19.2 ± 8.1 | 10.9 ± 6.3 |

所有指标以均值 ± 标准差表示;p值为独立样本t检验结果,显著性水平设定为 p < 0.05,*表示统计学显著(p < 0.05)。 |

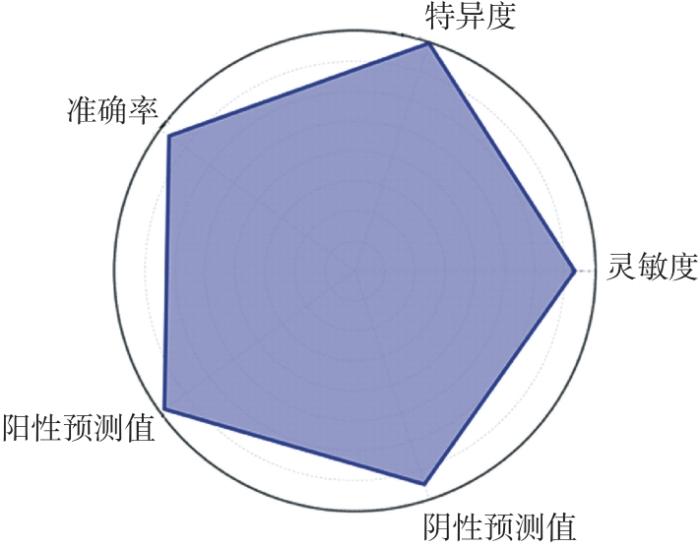

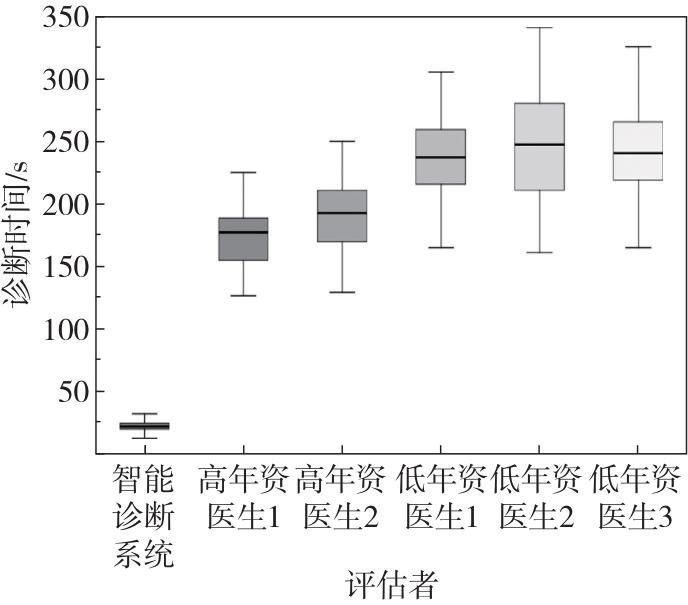

2.2 诊断性能评估

表4 智能诊断系统与放射科医生诊断效能对比(n=30)Table 4 Comparison of diagnostic performance between intelligent diagnostic system and radiologists (n=30) |

| 评估者 | 灵敏度/% | 特异度/% | 准确率/% | PPV/% | NPV/% |

|---|---|---|---|---|---|

| 智能诊断系统 | 73.3±3.2 | 80.0±2.8 | 76.7±4.3 | 78.6±3.5 | 75.0±3.0 |

| 高年资医生1 | 73.3±4.8 | 80.0±1.7 | 76.7±3.5 | 78.6±3.7 | 75.0±1.8 |

| 高年资医生2 | 93.3±3.4 | 86.7±1.0 | 90.0±1.2 | 87.5±4.8 | 92.9±4.4 |

| 低年资医生1 | 53.3±1.2 | 60.0±3.4 | 56.7±2.4 | 57.1±1.4 | 56.2±4.7 |

| 低年资医生2 | 46.7±3.8 | 66.7±4.9 | 56.7±3.6 | 58.3±1.5 | 55.6±4.4 |

| 低年资医生3 | 66.7±4.3 | 73.3±4.9 | 70.0±4.5 | 71.4±2.6 | 68.8±3.3 |

所有指标均以均值 ± 标准差表示。 |